把 OpenClaw 接入飞书后,很多用户第一次遇到的不是不会用,而是突然报错:前面还能正常对话,一到创建文档、生成长内容或执行复杂任务时,突然就提示 API rate limit reached。

这类问题看起来发生在飞书里,但根源往往不在飞书,而在模型 API 的限流和配额。

这篇文章想帮你一次讲清两个问题:

- 为什么接入飞书后的机器人会出现 API rate limit reached、429 Too Many Requests、insufficient_quota 等报错

- 2026 年国内主流模型的 Coding Plan 大致该怎么选,才能尽量避免“刚接好就限流”的尴尬

如果你最近正好遇到“飞书机器人突然不能用了”“创建文档失败”“明明充值了还是报限流”这类问题,这篇内容可以帮你少走很多弯路。

一、我养在飞书上的龙虾为什么"死"了?

现象复现

有用户满心欢喜部署好 OpenClaw 本地机器人,计划用来做日常记录、简单问答和知识库。开始对话都没问题,但在让机器人创建文档时触发报错:

API rate limit reached. Please try again later.

尝试重启服务、等待冷却,但问题依旧,机器人基本处于停用状态。挫败感拉满。

真相揭秘:这大概率不是飞书 API 的问题!

这里要硬核科普一下——「平台 API」 vs 「模型 API」 是两套完全不同的系统:

重点来了:飞书 API 的额度其实非常宽裕!所以当你看到 API rate limit reached 时,90% 的情况是模型在限流,不是飞书的问题。

痛点共鸣:为什么你明明充了值,却还报错?

很多用户都有这个困惑:

这是因为大多数模型厂商采用 RPM(Requests Per Minute) 和 TPM(Tokens Per Minute) 双重限流机制:

- RPM 限制:每分钟最多能调用多少次接口

- TPM 限制:每分钟最多能消耗多少 Token(文本长度)

即使你账户余额充足,如果频繁调用超过了 RPM/TPM 限制,依然会被拦住。

二、避坑指南:如何判断到底是谁在“限流”?

遇到API rate limit reached、429 Too Many Requests 这类报错时,先别急着重启服务。第一步不是“修”,而是先分清:限流到底发生在飞书侧,还是模型侧。

因为机器人虽然运行在飞书里,但一次请求往往会同时经过两套系统:

- 飞书 API:负责消息收发、文档创建、表格读写等平台动作

- 模型 API:负责理解问题、生成内容、处理上下文和工具调用

所以,报错出现在飞书里,不等于问题一定出在飞书。

先看日志,优先识别“报错来源”

最实用的判断方法,是直接看 OpenClaw 或中间层日志里的状态码、错误码和 provider 来源。

一个更稳的经验判断

如果你的机器人表现为:

- 简单聊天还能正常回复

- 一到长文本生成、复杂任务、多轮调用时就报 429

- 或者同一时间多个任务一起跑时容易失败

那大概率更像是模型侧限流。因为模型厂商通常会按 RPM(每分钟请求数)、TPM(每分钟 Token 数)、QPS / 突发流量保护 来限制调用。火山方舟、智谱、Kimi、阿里云百炼等官方文档里都明确提到这类机制。

反过来,如果你看到的报错上下文明确来自飞书开放平台,或命中的是飞书接口文档里写明的 Rate Limit,那么才更应该先查飞书侧。飞书也提供了通用错误码说明,而且不少接口本身就有单独的每秒 / 每分钟限额。

三、2026 市场盘点:国内主流模型 Coding Plan 哪家强?

前面说清楚了,很多看起来像“飞书机器人出问题”的报错,根源其实都在模型侧配额。

而真正决定你会不会频繁遇到限流的,往往不是部署动作本身,而是背后接入了哪一家模型、买了什么档位的 Coding Plan。 选得不合适,轻则高频报错,重则刚跑几个复杂任务就直接卡住。

所以接下来,我们把 2026 年国内主流模型厂商的 Coding Plan 做了一次集中盘点,帮助你从价格、限流和适用场景几个维度快速对比。

性价比之王:入门首选

如果你是个人开发者,想低成本上手飞书机器人:

- 火山引擎 ArkClaw Lite:首月 ¥9.9,极低试错成本,适合先体验

- MiniMax Starter:¥29/月,高频低价订阅,适合入门级开发

- GLM Lite:¥49/月,标准开发套餐,面向轻量个人开发者

生产力首选:重度用户

如果你每天高频使用,需要稳定可靠的生产力工具:

- 火山引擎 ArkClaw Pro:首月 ¥49.9,5倍用量,性价比高

- MiniMax Plus/Max:¥49-119/月,专业开发场景,prompts 配额充足

- GLM Pro:¥149/月,400 次/5小时,适合高频专业开发

- Coze 个人旗舰版:首月 5 折 ¥99,积分制灵活,加赠 39.8 万积分

不过话又说回来,现在你去各家官网去看这些方案,大概率也会遇到「售罄」「限量」「限额」的问题。

客观看,这一轮限流并不是厂商“故意卡人”。随着近期 OpenClaw 等智能体玩法快速升温,模型调用需求在短时间内集中放大,不少厂商都面临流量激增、资源调度和服务稳定性的多重压力,因此阶段性地采取限流、限售或套餐收紧措施,某种程度上也是为了保障整体服务可用性与用户体验。

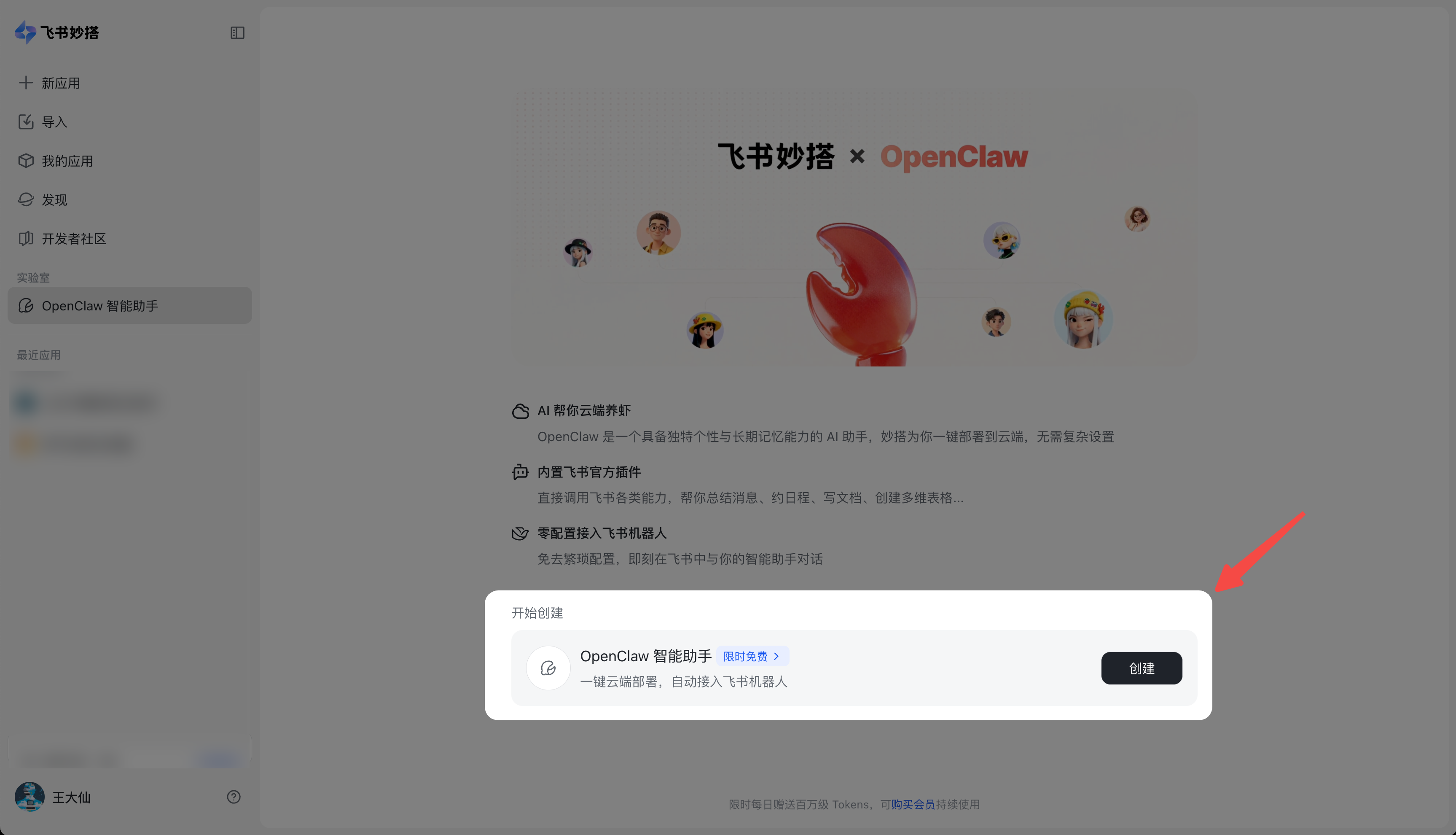

四、先别急着充太多:飞书官方 OpenClaw 也是一个低成本试水选项

前面盘点了各家模型厂商的 Coding Plan,本质上是在帮你解决一个问题:如果想把龙虾长期养在飞书里,哪种模型方案更适合自己。

但对很多刚入门的用户来说,当下最关心的其实不是“长期买哪家最划算”,而是另一件更现实的事:

我只是想先搞清楚 OpenClaw 到底是什么、能在飞书里做什么,有没有必要一上来就自己买一堆模型额度?

如果你正处在这个阶段,那现在其实还有一个更轻量的选择:直接试试今天已经上线的飞书官方 OpenClaw。 飞书已经发布了一键部署方案,主打的是免折腾环境、免手动接插件、开箱即可在飞书内对话和体验。对于只想先体验、先上手、先验证场景的人来说,这条路径明显比自己从零配服务器、买模型、排查限流更省心。

更关键的是,当前飞书官方 OpenClaw 还带有限时免费额度:新用户首日可领取 400 万免费 Token,后续每日可领取 150 万 Token,均为当日有效。 这意味着,如果你只是想体验基础对话、简单任务编排,或者先看看它在飞书里能不能融入自己的工作流,完全可以先用这部分免费额度跑起来,再决定后续是否需要单独购买其他模型厂商的 Coding Plan。

250px|700px|reset

飞书OpenClaw 当前可关注的权益

项目 | 当前口径 |

产品形态 | 飞书官方一键部署 OpenClaw |

适合人群 | 想先体验 OpenClaw、暂时不想自己折腾部署和模型配置的用户 |

首日免费额度 | 400 万 Token |

后续免费额度 | 每日 150 万 Token |

活动截止时间 | 2026 年 3 月 31 日 24:00(北京时间) |

额度有效期 | 当日有效,不累计到次日 |

怎么理解这波免费额度?

对于轻度用户来说,这类官方限时额度最大的价值,不是“永久免费替代所有 Coding Plan”,而是帮你用更低门槛完成第一轮验证:

- 先弄清楚 OpenClaw 在飞书里到底能做什么

- 先判断自己是不是高频用户

- 先验证消息问答、文档生成、简单协同这些场景是否适合自己

- 再决定后续要不要升级到更高额度方案,或切换其他模型厂商的 Coding Plan

也就是说,飞书官方 OpenClaw 更适合作为“入门体验”和“低成本试错”方案;如果你后续已经明确会高频使用、长时间运行、持续调用复杂任务,再去比较不同模型厂商的 Coding Plan,会更有针对性。

免费额度用完之后怎么办?

如果免费额度不够,用法上可以分成两步看:

使用阶段 | 更建议的做法 |

还在尝鲜、试用、验证阶段 | 优先用飞书官方 OpenClaw 的免费额度 |

已经开始高频使用,需要更稳定、更大额度 |

五、结语

很多看起来像“飞书机器人出问题了”的报错,本质上并不是飞书限流,而是模型侧的 Coding Plan、调用频率或配额先撞到了上限。

所以,比起盲目充值,更重要的是先判断是谁在限流,再选择适合自己使用场景的方案。

如果你只是想先低成本体验 OpenClaw、搞清楚它在飞书里能做什么,也可以直接试试飞书官方 OpenClaw。先跑起来、先用起来,再决定后续是否升级额度或切换其他模型方案,往往比一开始就重投入更合适。