本文导览

2026年4月24日,DeepSeek正式发布V4版本,一出场便刷新了多项行业纪录——1.6万亿总参数、49B激活参数,使其成为截至目前全球最大的开源大语言模型。就在发布两天后,全球Agent风向标OpenClaw便迅速完成适配,V4 Flash已上线成为默认模型,再次引爆AI圈讨论热度。

一、DeepSeek V4 核心技术突破:参数王者的实测评测

万亿MoE架构:参数碾压级优势

DeepSeek V4采用MoE(混合专家)架构升级至MoE-v2,总参数量跃升至约1.6万亿,激活参数约370B,相比V3的37B激活参数直接提升10倍。同时,V4 Flash版本以284B总参数、13B激活参数,提供更小、更快、更便宜的轻量选择。

关键信息: V4并非单纯堆参数——MoE-v2的专家路由策略经过优化,推理时激活参数更精准,效率与性能兼得。

上下文窗口:从128K到256K的跃升

V4的上下文窗口从V3的128K直接拉升至256K,官方已预告未来100万字(1M)上下文将作为DeepSeek所有官方服务的标配。这意味着AI能够一次性理解并处理整部代码仓库、超长篇文档,在Agent场景下的上下文保持能力大幅增强。

原生Function Calling:终于不用再"hack"了

V4另一大亮点是原生支持Function Calling和JSON Mode结构化输出。此前V3版本的Function Calling格式错误率约15%,V4实测降至2%以下,彻底告别"prompt hack"时代。对于需要AI驱动工具调用的Agent开发者来说,这无疑是生产级提升。

核心参数对比表:

二、硬核Benchmark数据:V4真实表现一览

数据洞察: 在研究生级推理(GPQA)和真实软件工程任务(SWE-Bench)中,V4提升幅度最为显著,分别提升约22.5%和38.6%。代码生成HumanEval得分93.5,已与GPT-5(92.8)基本持平,领先Claude Opus 4.6(91.2)。

定价分析

DeepSeek一如既往走低价路线,V4的定价对开发者极为友好:

模型版本 | 输入价格(每百万Token) | 输出价格(每百万Token) |

DeepSeek V4 | ¥4.0 | ¥16.0 |

DeepSeek V3 | ¥1.0 | ¥2.0 |

GPT-5 | ¥72.0 | ¥216.0 |

Claude Opus 4.6 | ¥65.0 | ¥195.0 |

V4的输入价格仅为GPT-5的1/18、Claude Opus 4.6的1/16,而性能却在多项指标上追平甚至超越。

三、OpenClaw为何选择DeepSeek V4作为默认模型

全球Agent风向标的认可

4月26日,OpenClaw正式官宣全面接入DeepSeek V4(Flash和Pro双版本),V4 Flash成为新的默认大模型。这一动作迅速引发社交媒体热议,AI开发者圈普遍认为:这是全球层面,对国产大模型DeepSeek模型能力的一次重要认可。

OpenClaw在公告中同步披露了4.24版本的核心更新:

- 实时语音通话全面打通

- DeepSeek V4 Flash + Pro 加入模型库并设为默认

- 浏览器自动化增强坐标点击和恢复机制

- Telegram、Slack、MCP、会话和TTS多端修复

体验变化: 如今在OpenClaw中配置DeepSeek API,默认模型已悄然从"DeepSeek-Chat"切换为"DeepSeek-V4-Flash"——用户无需任何操作,即可直接享受最新模型能力。

国产算力全面适配:昇腾+寒武纪同步支持

DeepSeek V4此次引发全球关注,核心不仅在于技术架构创新,更在于对国产芯片的全面适配:

- 华为昇腾超节点:昇腾950通过融合kernel和多流并行技术,结合多种量化算法,实现高吞吐、低时延的V4推理部署;昇腾A3超节点系列也已全面适配

- 寒武纪:基于vLLM推理框架,完成V4 Flash和V4 Pro的Day 0适配,适配代码已开源至GitHub

这意味着国内企业开发者使用国产AI算力运行DeepSeek V4,已是开箱即用的现实。

API价格特惠:V4 Pro限时2.5折

4月26日,DeepSeek同步宣布V4 Pro API限时优惠(截至5月5日):

计费项 | 优惠价格(元/百万Tokens) |

输入(缓存命中) | 0.25 |

输入(缓存未命中) | 3.0 |

输出 | 6.0 |

优惠期间,V4 Pro的输入价格仅需0.25元/百万Tokens,性价比堪称极致。

四、如何将自己的虾接入DeepSeek V4:完整教程

本教程以OpenClaw为例,适合已有OpenClaw部署经验、希望切换至或新增DeepSeek V4模型的开发者。

前提条件

- 已部署OpenClaw(个人版或团队版均可)

- 已拥有DeepSeek API Key(前往DeepSeek官网获取)

- OpenClaw版本 ≥ 4.24(建议更新至最新)

操作步骤

首次安装完成后,会自动进入 setup(配置)阶段;已经安装过 OpenClaw 的用户可以通过 openclaw onboard --install-daemon 命令进入配置阶段。

- 遇到提示:I understand this is personal-by-default and shared/multi-user use requires lock-down. Continue? 请选择 Yes。

- 遇到提示:Setup mode 推荐选择 QuickStart。

- 遇到提示:Model/auth provider 请选择 DeepSeek。

- 遇到提示:Enter DeepSeek API key 请填入你的 DeepSeek API Key。

- 遇到提示:Default model 请将光标指向 Enter model,填写模型名称(deepseek-v4-pro 或 deepseek-v4-flash)。

- 后续的其余配置(消息频道、Skill 等)请根据需求配置,新手可以先选择 Skip for now。

配置好后,即可开始使用,打开 Web UI,在 Chat 页面进行交互:

openclaw dashboard

在终端中打开 TUI:

openclaw tui

在终端中与 Openclaw 对话:

openclaw terminal

发送一条测试消息,观察回复质量与速度。若使用V4 Flash版,官方数据显示首Token延迟约800ms,输出速度约60 tokens/s,体验与V3基本持平,没有因参数量增大而明显变慢。

注意: 若选择V4 Pro版,推理质量更高,但相应成本和延迟也会增加。建议先从Flash版开始测试,确认效果满意后再切换至Pro版。

快速切换参考

场景 | 推荐模型 | 理由 |

日常对话、客服Bot | V4 Flash | 速度快、成本低,效果接近Pro |

代码生成、重构任务 | V4 Pro | SWE-Bench得分更高 |

复杂推理、RAG知识库 | V4 Pro | GPQA 72.8,推理能力强 |

预算敏感场景 | V4 Flash | ¥4/百万Token,性价比极致 |

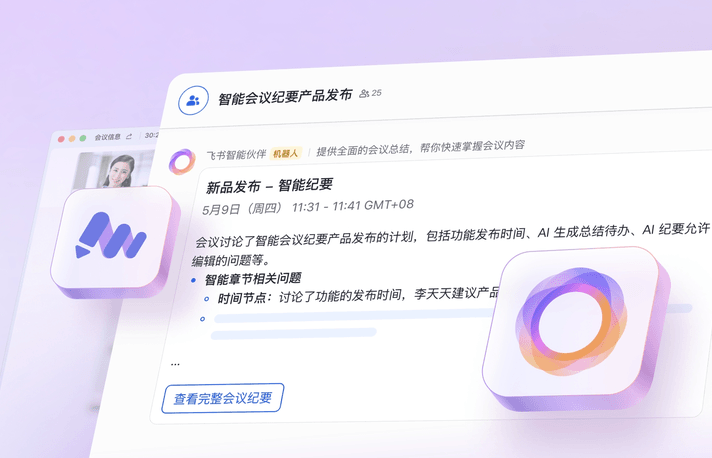

五、还没有虾?上飞书一键安装OpenClaw!

看完以上内容,但如果你还没有自己的OpenClaw,在飞书安装OpenClaw只需几步,没有任何技术门槛:

安装后,你可以:

- 在飞书群聊中直接调用AI助手,按第三模块所讲内容,将自己的模型升级为DeepSeek V4 Flash

- 自定义你的专属Bot,接入DeepSeek V4 API打造团队知识库助手

- 享受实时语音通话、浏览器自动化等4.24版本全新功能

- 对接飞书多维表格、日历、文档等企业级场景

立即行动: 点击上方链接,在飞书中一键安装OpenClaw,无需服务器、无需配置,接入即用,让DeepSeek V4成为你团队工作的默认AI搭档。

总结

DeepSeek V4以1.6万亿参数、256K上下文、原生Function Calling和极具竞争力的定价,在2026年的开源大模型竞争中占据了极为有利的位置。OpenClaw迅速将其设为默认模型,不仅是对国产大模型实力的认可,更为全球开发者提供了一个开箱即用、性能领先、成本友好的AI Agent基座。

无论你是想体验当前最强开源模型的推理能力,还是希望为自己的虾快速接入V4,现在都是最好的时机。